“数科赋能、世经领航:学科融合系列讲座(七)”,于11月25日(周二)下午1点30分在邯郸校区H6101教室顺利开讲。主讲人是来自大数据学院的张力教授。张教授同时担任上海创智学院的全职导师,学术背景深厚。

AI 如何 “理解” 世界?从计算机视觉的底层逻辑说起

人工智能领域的核心目标之一,就是让计算机能够像人类一样去“理解”我们所处的世界,而计算机视觉正是实现这一目标的关键技术方向。

1、图像识别:计算机面对的 “原始难题”

张老师先从最基础的“识别猫的图像”说起 ——对人类而言,识别一只猫是本能,但对计算机来说,这是一系列复杂的挑战:

计算机 “看到” 的图像,本质是一个 “数字矩阵”(比如一张 800×600 像素的彩色图,对应的是 800×600×3 的数字矩阵),直接处理如此高维度的数据,计算量和难度都极大;

更麻烦的是,图像的任何变化都会让这个数字矩阵彻底改变:比如把猫的图片转个角度、换个光照环境、让背景变得杂乱、猫做出不同的动作,或是猫的身体被部分遮挡,这些都会导致计算机接收到的数字矩阵完全不同,传统方法根本无法稳定识别。

2、深度学习的破局:用 “参数化方法” 找对规律

张老师解释道,计算机视觉之所以能实现突破,核心是依赖深度学习技术。而深度学习解决图像识别问题的核心逻辑,是参数化方法(ParametricApproach):

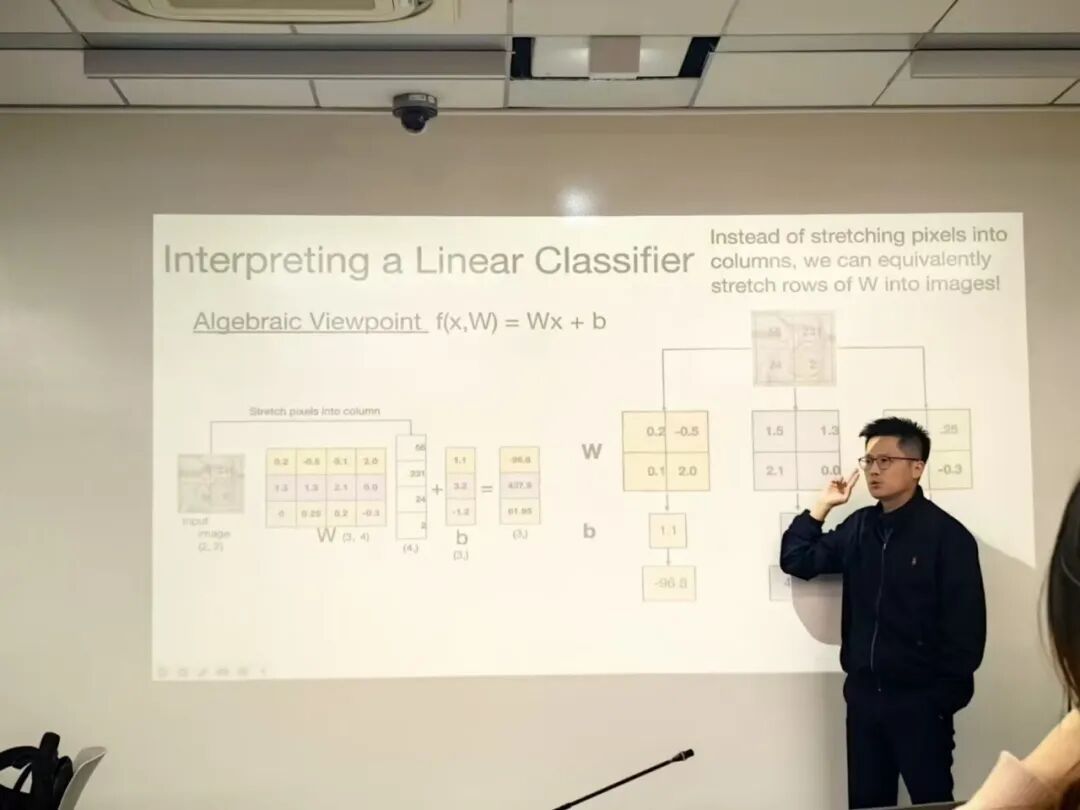

具体来说,就是把代表猫的图像的3072个像素(也就是那个数字矩阵)作为输入x,代入公式f(x,W)=Wx+b中计算——我们需要找到一个维度为10×3072的矩阵W,通过这个矩阵和输入的x做运算,最终输出10个得分(对应猫、狗、汽车等10个类别),得分最高的就是计算机判断的类别。

换句话说,这个方法的本质是“为每个类别找一个特征模式”——我们用越多的数据去训练模型,这个矩阵W就会越精准,计算机识别不同类别物体的能力也就越强。

3、Ilya Sutskever 的创新:抓住问题的“本质路径”

在AI的发展中,“人为设计”和“自主学习”的边界一直是关键。SergeyLevine曾提出一个重要观点:“在任何可学习系统上,任何不是通过学习获得,而是人手设计的组件,最终都会成为性能的瓶颈。”

这句话也解释了为什么DeepMind能把AI应用到生物、材料等不同领域——因为这些应用本质上只是更换了输入模型的数据,让模型自主去学习不同领域的规律,而不是人为给模型设定各种“行业规则”。

AI 如何 “创造” 世界?从数据闭环到具身智能的实践

接下来,张老师为我们讲解了AI如何“创造”世界。当AI能够“理解”世界之后,它的“创造”能力,其实是基于数据和模型的“场景应用与持续迭代”——从虚拟内容到物理交互,AI正在逐步参与到“世界的构建”中。

1、AI 创造的核心:80% 的精力都在 “处理数据”

张老师提到,AI研究的整个流程中,80%的时间其实都在和数据打交道,具体的流程是这样的:先采集数据,用这些数据训练模型,然后测试模型的效果;在测试中,我们会发现很多“边缘场景”(也就是模型处理不好的特殊情况);接下来,我们需要专门去采集这些边缘场景的数据,再用这些新数据去微调模型——如此循环往复,模型的能力才会越来越强。比如自动驾驶领域,当车辆遇到“水坑倒映出周边楼房”的场景时,模型往往难以判断这是倒影还是真实的物体,这时候就必须专门采集这种边缘场景的数据,让模型学会处理这种特殊情况。

2、行业应用:多模态的 “降本” 与 “细节难题”

AI的“创造”能力已经在很多行业落地,比如淘宝这样的电商平台,会用AI生成模特的服装展示——这能大幅节省传统拍摄的成本,但也会出现问题:AI生成的内容,往往会在服装的细节上出错(比如纽扣的数量、面料的纹理),这正是多模态AI在还原真实世界细节上的短板。

3、闭环测试:用 “仿真世界” 补全数据的缺口

在实际应用中,我们经常会遇到“数据不足”的问题——比如前沿技术领域,根本没有足够的真实数据可用。这时候,闭环测试(Closed-looptesting)就能发挥作用:我们可以构建一个“仿真世界”,在这个虚拟世界中生成大量的虚拟数据,用这些数据来训练模型。

不过这里需要注意:如果模型是用“片面的数据”训练出来的,那么这个“世界模型”的性能是有上限的——它永远无法处理那些没被包含在训练数据里的场景。

4、前沿探索:具身智能的“新轨迹场景合成”

讲座中,张老师还展示了在“具身智能”领域的最新研究。具身智能是让AI通过物理实体(比如机器人)在真实世界中交互,而目前这个领域的难点之一,就是“新轨迹场景合成”——简单说,就是让AI能够自主创造出之前从未出现过的动作轨迹和场景,这是让AI更灵活参与世界构建的关键。

问答环节:关于AI发展的核心讨论

Q1:在前沿技术创新领域,深度学习模型需要大量数据驱动,但前沿技术往往数据量不足,这该怎么解决?

A:我们可以通过构建虚拟世界,在虚拟环境中产生虚拟数据,用这些虚拟数据来补充真实数据的缺口。

Q2:当前的 AI 发展,大量依赖算力投入和数据量,这会不会导致难以产生更大的突破性创新?有没有可能出现成本更低的模型?

A:算力投入和模型创新其实并不冲突,AI 的性能本身是 “性能驱动” 的 —— 算力和数据的提升,反而能支撑更复杂的模型创新。

Q3:平时用图像识别软件时,如果遇到猫长得很像狗的情况,人类可以凭逻辑判断,但计算机很难区分,有没有可能基于逻辑规则来训练数据?

A:人为把规律化的东西加入模型,这种操作其实很难规模化;而且按照之前提到的观点,这种人为加入的组件,最终会成为模型性能的瓶颈。现在的模型本身是有更新机制的,还是应该依赖数据让模型自主学习更通用的规律。

AI 如何 “理解” 世界?从计算机视觉的底层逻辑说起

从“识别一只猫”的底层逻辑,到“生成虚拟模特”的行业应用,再到“具身智能”的前沿探索,这场讲座其实讲透了AI的核心:它对世界的“理解”,是通过数据找到规律;而它的“创造”,则是把这些规律投射到不同场景中,再通过数据闭环持续优化。

如今的AI,既不是“凭空创造”,也不是“机械模仿”——它是在“数据的海洋”里学习世界的运行逻辑,再用这些逻辑去拓展世界的可能性。当然,它也有局限:数据的片面性会限制它的边界,人为的干预会成为它的瓶颈。但不可否认的是,当AI把“理解”的规律转化为“创造”的工具时,它已经在悄悄改变我们与世界互动的方式。

或许未来,AI对世界的“理解与创造”,会从“学习人类定义的规律”,走向“探索人类尚未发现的可能性”——而这一切的起点,依然是数据与对本质问题的追问。

返回顶部

返回顶部